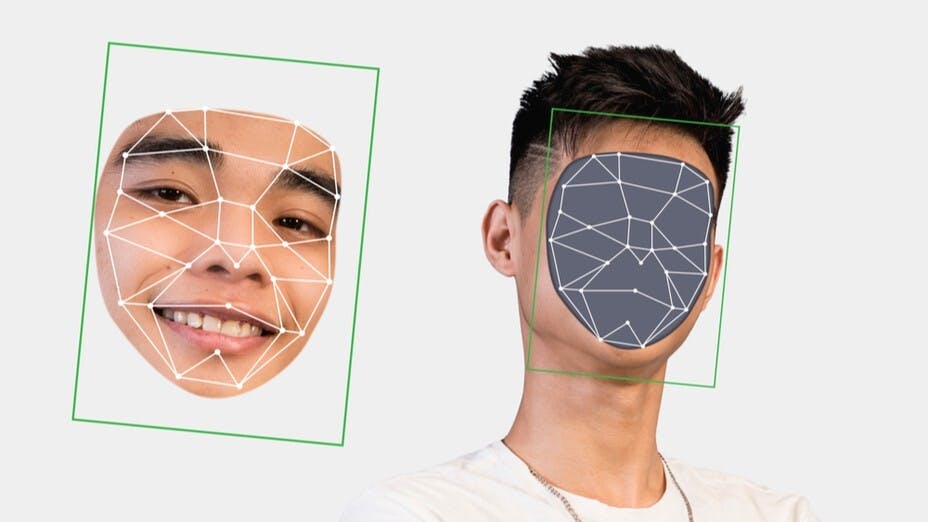

「深度偽造」(Deep Fake)技術利用人工智能進行人體圖像合成,基本上是將已有的圖像或影片「疊加」(Superimpose),從而偽造出一套仿真度超高的圖像或影片。例如,麻省理工學院「深度學習入門」課程的第一課,老師利用深度偽造技術開發了一段美國前總統奥巴馬發言的錄像,內容是由他親身介紹深度學習。儘管總統對人工智能科技一竅不通,但錄像卻栩栩如生,初接觸者都信以為真。

稍一不慎 道德淪亡

深度偽造把人工智能技術發揮得淋漓盡致,可惜它卻經常被不法之徒使用,例如偽造名人的性愛影片,以及散播假新聞,近年多不勝數,全球瘋傳。在政治上,去年美國總統選舉期間,特朗普及拜登雙方的支持陣營都發放不少深度偽造的假新聞,打擊對方的聲譽。

有網民認為自己並非知名人士,也非政客,絕對不是黑客的攻擊目標,因此深度偽造技術對他們影響不大。不過隨着此技術最近又有新進展,功能進一步提升,已經被應用於大眾的日常生活之中。臉書的人工智能組(Facebook AI)推出「文字風格刷」(Text Style Brush)技術,用戶只需要提供數個手寫字串,「文字風格刷」便能學會他寫字的筆風,之後便可以為所欲為,以同樣之寫字風格進行大規模抄寫,以假亂真。

除了數碼版的抄寫員之外,抄寫機器人的研究也炙手可熱。中小學生得悉這發明當然十分雀躍,他們熱切期待這發明能盡快被轉化為產品,解決他們被老師罰抄之苦。然而,在工商業界的應用場景中,這技術推出之後,文件被冒簽的風險便難以避免,影響營商。

現實生活中,深度偽造技術會引發道德和法律問題,首當其衝的是侵犯版權,受害者的圖像在未經他人同意之下被濫用,也會導致當事人的私隱外洩,所造成的後果可大可小,稍一不慎會令受害者聲譽受損,甚至乎家庭破裂。另外,偽造的失實謊言不但會影響當事人,很多時也會影響整個社會,例如煽動種族仇恨便是其中駭人聽聞的例子。

機器代人 窒礙創意

另外,有網民認為深度學習是人工智能版的二次創作手法,能提供無限創意空間,但筆者對這觀點不以為然。深度偽造背後的基礎技術是深度學習,這技術的核心任務,是從既定的訓練數據中,利用科學算法去學習輸出及輸入數據之間的配對模型,之後用戶便可以利用該模型,為未來新輸入的數據進行輸出的推算。

古語道:「熟讀唐詩三百首,不會作詩也會吟」,利用深度學習所訓練出來的人工智能系統,在預設應用範圍內運作是絕對可行的,不過當系統遇上從未學習過的輸入數據時,它便可以會推算失準,因而作出錯誤的決定。理論上人工智能系統的研發目標是「機器代人」,而深度學習主要集中在輸入與輸出的配對而已,做法無疑窒礙創意,影響人工智能的應用原創性。

「水能載舟,亦能覆舟」,「深度偽造」並非一面倒只具破壞性,問題在於使用者的出發點,例如有藝術工作者利用這技術把已故的明星「重生」,出現在電影中,增加電影的可觀性,上述奧巴馬介紹科技的短片便是類似的成功個案。歸根究柢,「深度偽造」一詞有誤導之嫌,把這項先進人工智能技術貼上了負面標籤,令一般人視之為不良的算法。

因此,筆者建議業界改名,把這技術中性地稱為「深度模仿」,這將有助釋除大眾不必要的疑惑。

原刊於《星島日報》,本社獲作者授權轉載。