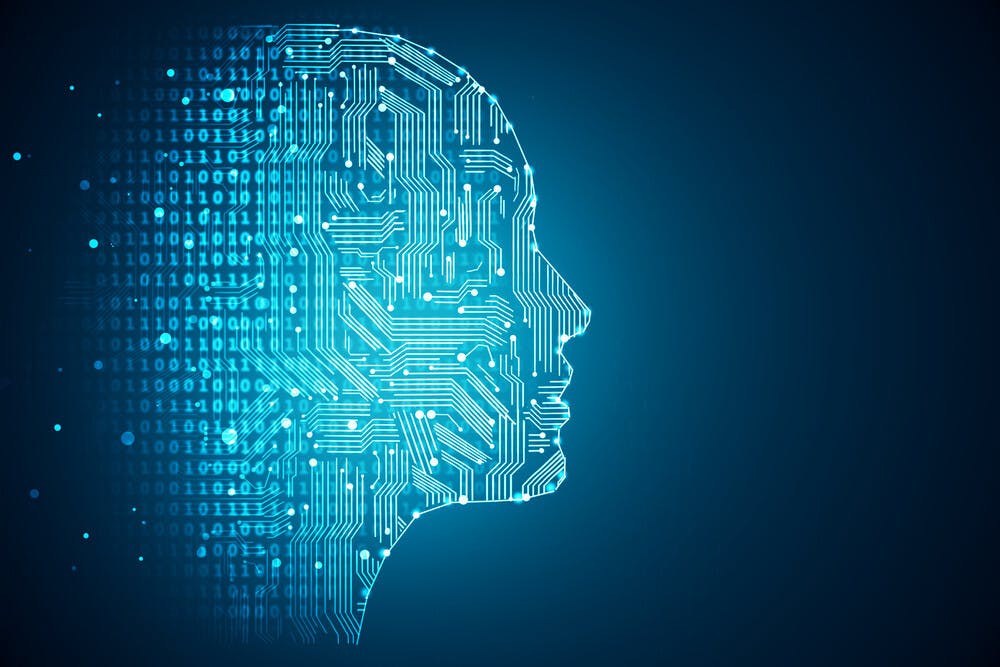

人類社會正面臨AI科技應用的爆發性成長帶來的全面衝擊,其中最令人擔心的是AI的軍事應用。

這幾年,Google DeepMind共同創始人蘇勒曼(Mustafa Su-leyman)就警告,AI科技可能帶來第三次戰爭型態革命,其顛覆性作用不下於火藥及核武的發明。他呼籲聯合國推動禁用AI武器(俗稱殺人機器人)的全球公約,並設置監控機構。

今年4月,一項與美國國防部的合作計劃在Google內部引發員工反彈,有逾3千名Google員工聯署,要求執行長終止這項幫助美軍更好地辨識作戰目標的計劃,以符合Google「不作惡」的行為準則。他們還要求公司增訂一條「永遠不再開發戰爭相關技術」的條款。

AI武器的威脅

殺人機器人最可怕之處是可以讓發動戰爭的一方更為輕率,可以殺人不眨眼,因為不需擔心人員傷亡或士兵心理創傷。

美國從奧巴馬政府開始,就多次利用無人飛機在阿富汗、伊拉克與敘利亞進行祕密打擊行動。而且這些武器將愈來愈多樣化,既可以是有大規模殺傷力的巨型機器人,可以飛天也可以潛海,也更可以是來去無蹤影的殺人小蜜蜂。同時,AI武器的研發更為隱蔽,比監控核武或化武更困難。

由於AI科學家的呼籲沒有得到各國積極回應。7月18日在瑞典斯德哥爾摩舉辦的2018「國際人工智慧聯合會議」上,包括特斯拉執行長馬斯克與Google DeepMind 3位共同創始人在內的多位AI領域領軍人物共同簽署《禁止致命性自主武器宣言》,宣誓不參與致命性自主武器系統(LAWS)的開發、研製工作。

這場宣誓行動由總部位於波士頓的非營利組織「未來生命研究所」發起,來自36個國家160個AI領域相關企業,以及90個國家的2400位專家以個人名義簽署了宣言。

令人擔憂的是,言者諄諄,聽者藐藐。美國軍方早已私下進行各種AI武器實驗,中俄軍方也急起直追。

如果聯合國安理會五大常任理事國對限制或禁止AI武器的呼籲無動於衷,任何全球性禁止公約都將像是遠在天邊的彩虹。現在看來,要阻止AI武器的全面擴散,只能靠科學社群內部的自發性覺醒與自律。

原刊於《天下雜誌》,獲作者授權發表。